前不久,英伟达在对gtc2024大会进行预热时称,黄仁勋将在大会上发布加速计算、生成式ai以及机器人领域的最新突破性成果。在ai持续火爆的当下,英伟达gtc2024的官宣无疑成为ai领域的重头戏。果不其然,在今日凌晨,黄仁勋抛出了重磅炸弹。

英伟达推出成本与能耗较前代改善25倍的ai芯片

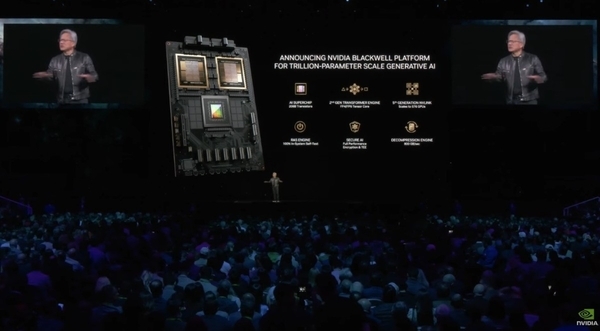

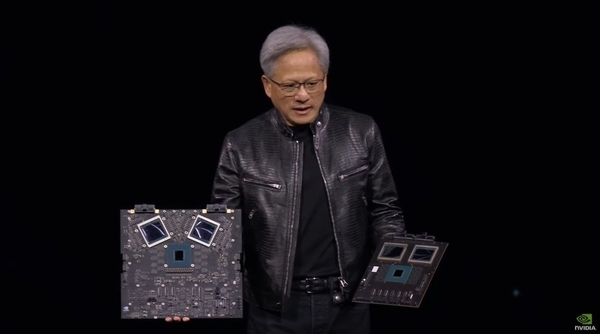

英伟达在发表《见证ai的变革时刻》演讲中宣布,正式发布名为blackwell的新一代ai图形处理器(gpu),称其“非常非常强大”,基于blackwell技术,英伟达将推出b200和gb200系列芯片。

据悉,blackwell平台能够在万亿参数级的大型语言模型(llm)上构建和运行实时生成式ai,而成本和能耗比前身低25倍。英伟达还称,blackwell架构系列芯片是迄今为止功能最强大的ai芯片家族。

据黄仁勋介绍,b200拥有2080亿个晶体管,而h100/h200有800亿个晶体管,采用台积电4np工艺制程,可以支持多达10万亿个参数的ai大模型。该芯片还通过单个gpu提供20 petaflops的ai性能,而单个h100最多可提供4 petaflops的ai计算。

blackwell架构系列芯片也将降低能耗,仁勋举例称,如果要训练一个1.8万亿参数量的gpt模型,需要8000张hopper gpu,消耗15兆瓦的电力,连续跑上90天。但如果使用blackwell gpu,只需要2000张,同样跑90天只要消耗四分之一的电力。

微软azure、aws、谷歌云等一众科技巨头都是blackwell架构的首批用户。“生成式ai是我们这个时代的决定性技术。blackwell是推动这场新工业革命的引擎。通过与世界上最具活力的公司合作,我们将实现ai在各行各业的承诺。”黄仁勋表示。

发布新一代ai超级计算机

英伟达还宣布新一代ai超级计算机——nvidia dgx superpod,其搭载nvidia gb200 grace blackwell超级芯片。黄仁勋称,这台ai超级计算机可以用于处理万亿参数模型,能够保证超大规模生成式ai训练和推理工作负载的持续运行。

在配置上,全新dgx superpod采用新型高效液冷机架级扩展架构,基于nvidia dgx gb200系统构建而成,在fp4精度下可提供11.5 exaflops的ai超级计算性能和240 tb的快速显存,且可通过增加机架来扩展性能。

与nvidia h100 tensor core gpu相比,gb200超级芯片在大语言模型推理工作负载方面的性能提升了高达 30倍。

在nvidia gb200的支撑下,性能也有了大幅度提升。据悉,每个dgx gb200系统搭载36个nvidia gb200超级芯片,共包含36个nvidia grace cpu和72个nvidia blackwell gpu。这些超级芯片通过第五代 nvidia nvlink连接成一台超级计算机。

基于dgx gb200和dgx b200系统构建而成的nvidia dgx superpod将于今年晚些时候提供。“vidia dgx ai超级计算机是推进ai产业变革的工厂。新一代dgx superpod集 nvidia加速计算、网络和软件方面的最新进展于一体,能够帮助每一个企业、行业和国家完善并生成自己的ai。”黄仁勋表示。

英伟达推出系列微服务

在演讲中,黄仁勋还宣布推出ai微服务,用于在自己平台上创建和部署定制应用。黄仁勋表示:“未来软件开发或许要依靠nims(nvidia inference micro service),用与ai聊天的形式调动一堆nims来完成训练、应用的部署。”而英伟达的愿景是成为ai软件的“晶圆厂”。

这些云原生微服务目录在nvidia cuda平台上开发,其中包括nvidia nim微服务,可适用于nvidia及kb88凯时官网登录的合作伙伴生态系统中20多个热门的ai模型进行推理优化。在性能表现上,nim微服务提供基于nvidia推理软件的预构建容器,包括triton推理和tensorrt-llm,使开发者能够将部署时间从几周缩短至几分钟。

同时,用户现能够以nvidia cuda-x微服务的形式使用nvidia加速软件开发套件、库和工具,用于检索增强生成(rag)、护栏、数据处理、hpc等。cuda-x微服务为数据准备、定制和训练提供端到端的构建模块,助力各行各业加快开发生产级ai。

nvidia还发布20多项医疗nim和cuda-x微服务。黄仁勋表示:“这些精心挑选的微服务为nvidia全栈计算平台增添了新的一层,连接起了由模型开发人员、平台提供商和企业组成的ai生态系统,使其能够通过标准化的路径来运行针对nvidia cuda安装基础(在云、数据中心、工作站和pc中的数以亿计的gpu)优化的定制ai模型。”

除了领先的应用提供商外,nvidia生态系统中的数据、基础设施和计算平台提供商也在使用nvidia微服务,为企业带来生成式ai。

包括box、cloudera、cohesity、datastax、dropbox和netapp在内的顶级数据平台提供商正在使用nvidia微服务,帮助客户优化rag管道,并将专有数据集成到生成式ai应用中。

人形机器人通用基础模型发布

当前关注度较高的人形机器人也出现在黄仁勋的演讲中,他表示:“在我们的世界里,类人机器人很有可能会发挥更大的作用,我们设置工作站、制造和物流的方式,并不是为人类设计的。因此,这些机器人的部署可能会更有成效。”

黄仁勋在演讲中发布了人形机器人通用基础模型 project gr00t,并发布基于 nvidia thor系统级芯片(soc)的新型人形机器人计算机 jetson thor,对 nvidia isaac机器人平台进行了重大升级。

gr00t使用的isaac工具还能够为在任何环境中的任何机器人创建新的基础模型,包括用于强化学习的isaac lab和用于计算编排服务的osmo。

新的isaac lab是一个gpu加速、性能优化的轻量级应用,基于isaac sim而构建,专门用于运行数千个用于机器人学习的并行仿真。而osmo是在分布式环境中协调数据生成、模型训练和软硬件在环工作流。

最新发布的jetson thor是一个全新的计算平台,能够执行复杂的任务并安全、自然地与人和机器交互,具有针对性能、功耗和尺寸优化的模块化架构。

在黄仁勋的介绍中,我们了解到,包括一个带有transformer engine的下一代gpu,其采用nvidia blackwell架构,可提供每秒800万亿次8位浮点运算ai性能,以运行gr00t等多模态生成式ai模型。

“nvidia正在为1x technologies、agility robotics、apptronik、波士顿动力公司、figure ai、傅利叶智能、sanctuary ai、宇树科技和小鹏鹏行等人形机器人公司开发ai平台。”黄仁勋如是说。

发布集中式车载计算平台、交换机......

英伟达还宣布交通运输领域的领先企业已采用nvidia drive thor集中式车载计算平台,包括新能源汽车(nev)、卡车、自动驾驶出租车、自动驾驶公交车和无人配送车。

drive thor可提供丰富的座舱功能,以及安全可靠的高度自动化驾驶和无人驾驶功能,并将所有功能整合至同一个集中式平台上。黄仁勋在演讲中指出,这款新一代自动驾驶汽车(av)平台将搭载专为transformer、大语言模型(llm)和生成式ai工作负载而打造的全新nvidia blackwell架构。

据悉,比亚迪、广汽埃安、小鹏、理想汽车和极氪均已宣布将在drive thor上构建其未来的汽车产品。plus、waabi、文远知行、nuro将选择drive thor进行创新与验证。drive thor预计最早将于明年开始量产。

在演讲中,黄仁勋还发布专为大规模ai量身订制的全新网络交换机——x800系列。nvidia quantum-x800 infiniband网络和nvidia spectrum-x800以太网络是全球首批高达 800gb/s端到端吞吐量的网络平台,将计算和ai工作负载的网络性能提升到了一个新的水平。

写在最后

技术发展日新月异。文生视频sora的发布、人形机器人赛道的爆火,人工智能领域正在经历着一次又一次的变革与发展。作为人工智能的重要元素之一,算力尤其是智算已经成为ai领域的刚需。

在此背景下,我们看到英伟达在算力领域的迭代极为迅速,从算力、硬件端推动ai的进步。当然,除了在算力的发布外,gtc2024上还带来应用层、生态层的诸多惊喜。

对于此次发布,机构人士认为,2024年英伟达gtc大会超预期火爆,预示着ai商业落地的趋势或将加速,而算力基础设施为ai应用的持续落地的基础,英伟达供应链及其他ai算力及应用相关公司将迎来发展机遇。

未来已来,2024年英伟达已抛出性能更强的ai处理器blackwell,新一轮的ai竞赛也将拉开帷幕。