*简介:ollama-webui是一个开源项目,简化了安装部署过程,并能直接管理各种大型语言模型(llm)。本文将介绍如何在你的macos上安装ollama服务并配合webui调用api来完成聊天。

开源地址

- ,开源不易感谢star

环境要求

- macos系统

- nodejs >= 18

- 没错,其他的都不需要了

目标

- 运行ollama

- 启用webui

- 启用api服务

- 启用rag

安装ollama

- d88尊龙官网手机app官网直接安装,。

- 选择macos,点击download for mac下载

- 得到的是个压缩包,解压,然后一路next

- 安装完成,直接使用

- 系统可会默认启动ollama,在电脑的右上角能看到这个标记,如果没有,请看下一步

在命令行使用ollama

-

打开终端,输入

ollama -h,查看到所有的命令。 -

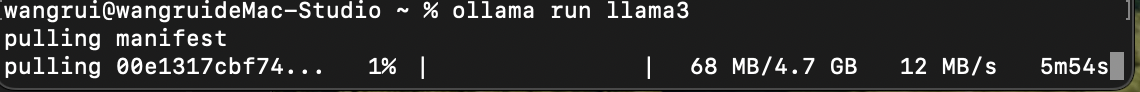

点击搜索你需要的模型,然后直接启动,例如:

ollama run llama3,可看到下载速度非常快,取决于你的宽带。

-

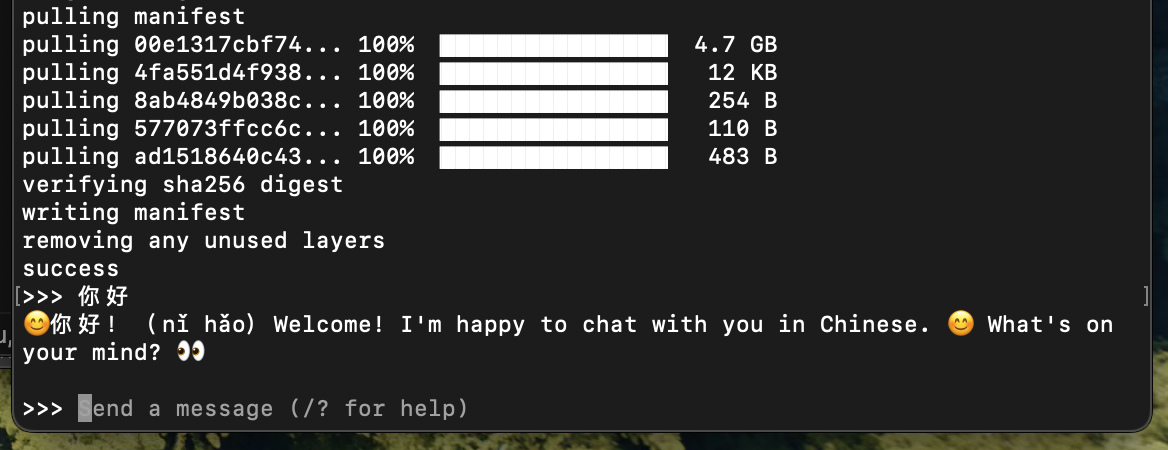

下载完成,现在可以与他聊天了

-

control d退出聊天

调用ollama的api

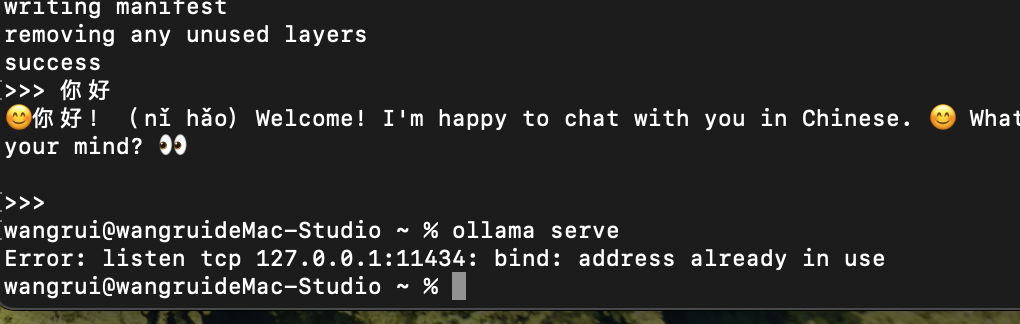

- ollama提供api的形式调用,直接查看

ollama serve启动服务,发现端口被占用

需要点击电脑右上角的ollama图标来退出ollama,再来运行ollama serve

- ollama服务默认是http://127.0.0.1:11434,目前在macos上修改ip和端口无效,官方未解决(2024-5-9)。

- 调用api会出现跨域,所以需要做一个服务端。我已经做好了,点击,感谢star

安装ollama-webui和serve

-

git clone https://github.com/812781385/ollama-webui.git -

cd client -

pnpm i -

修改.env 里的

vite_app_axios_base_url为自己的ip地址 -

npm run dev运行webui -

cd serve -

npm i -

npm run dev运行服务端 -

浏览器访问

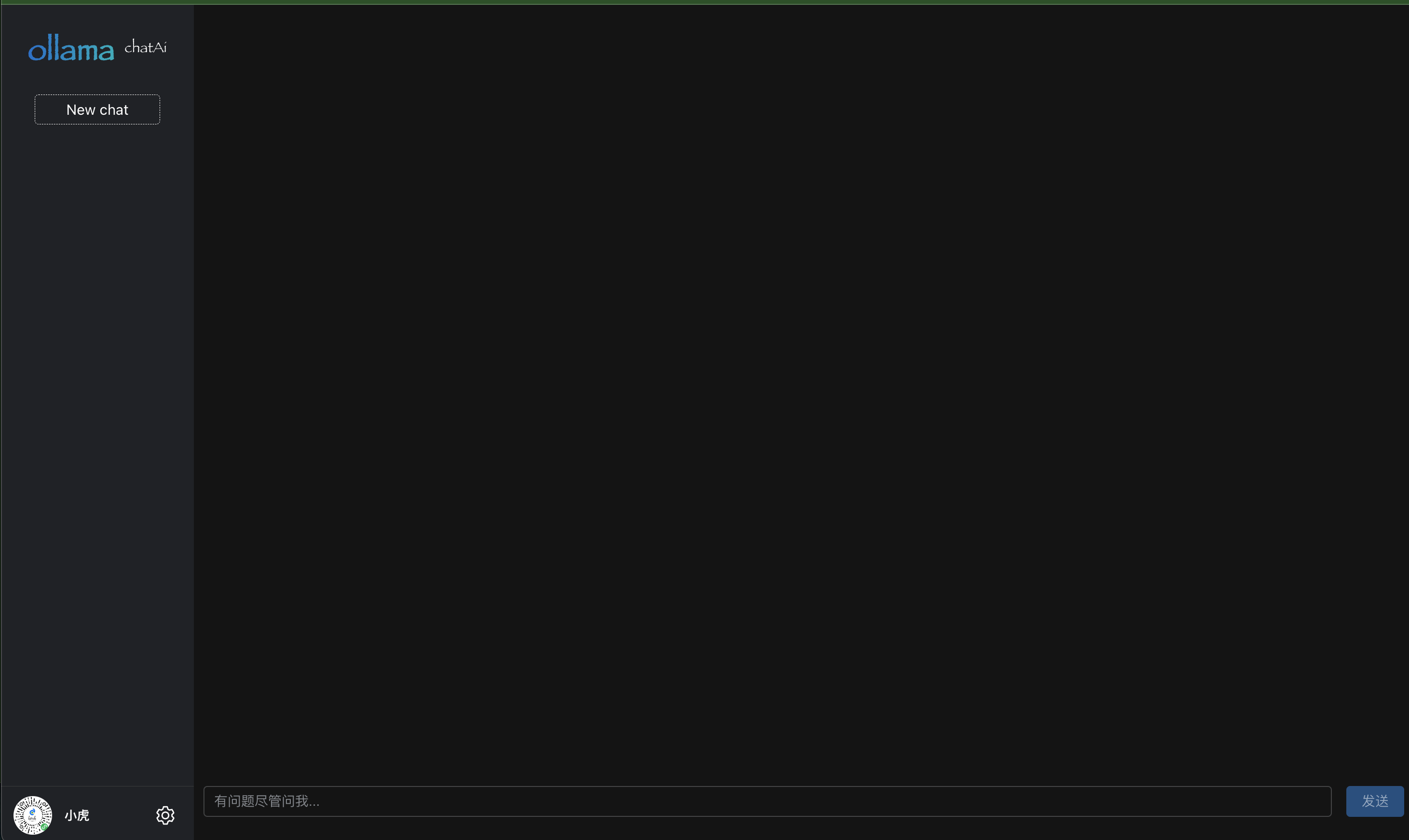

http://localhost:8080/

-

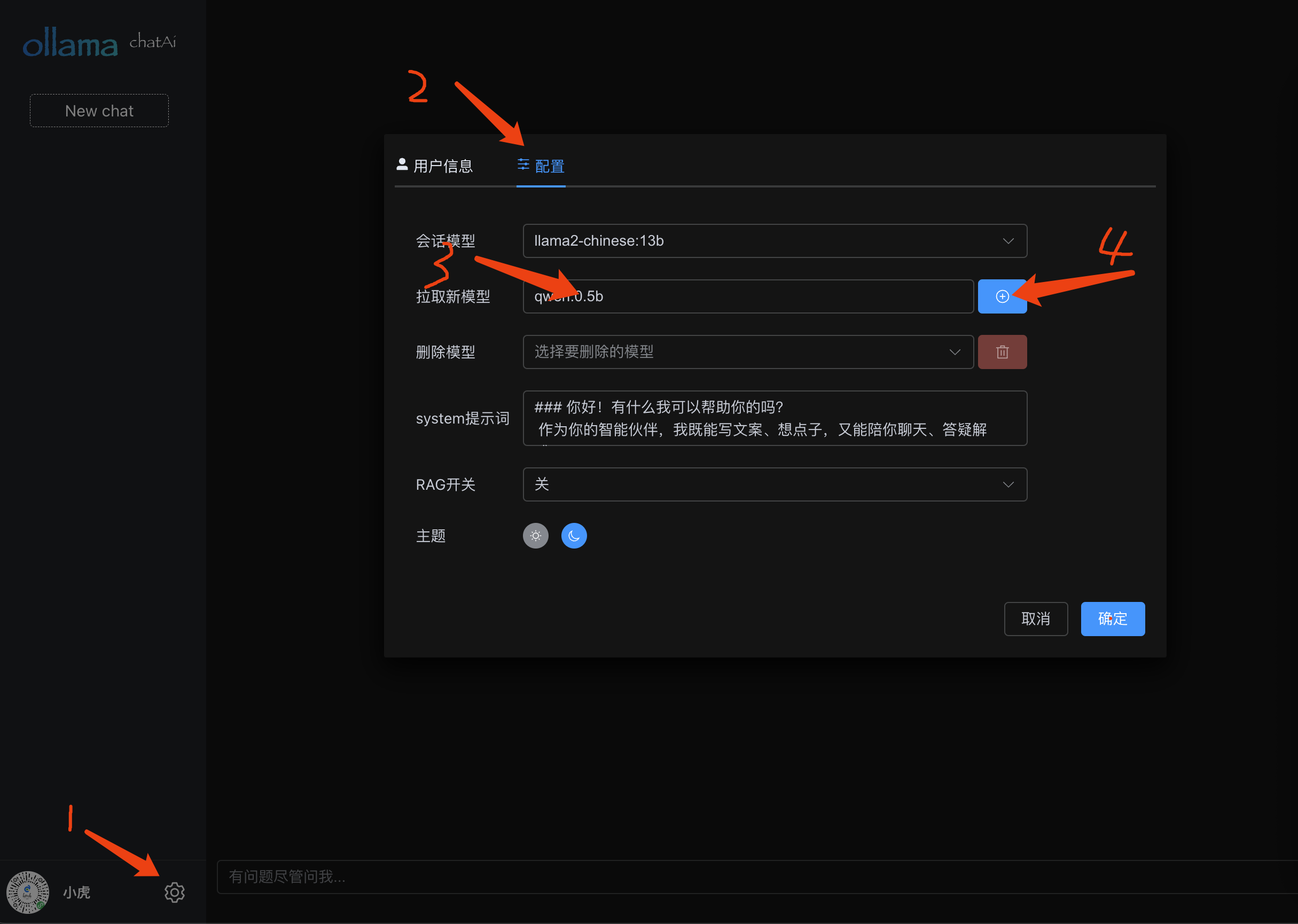

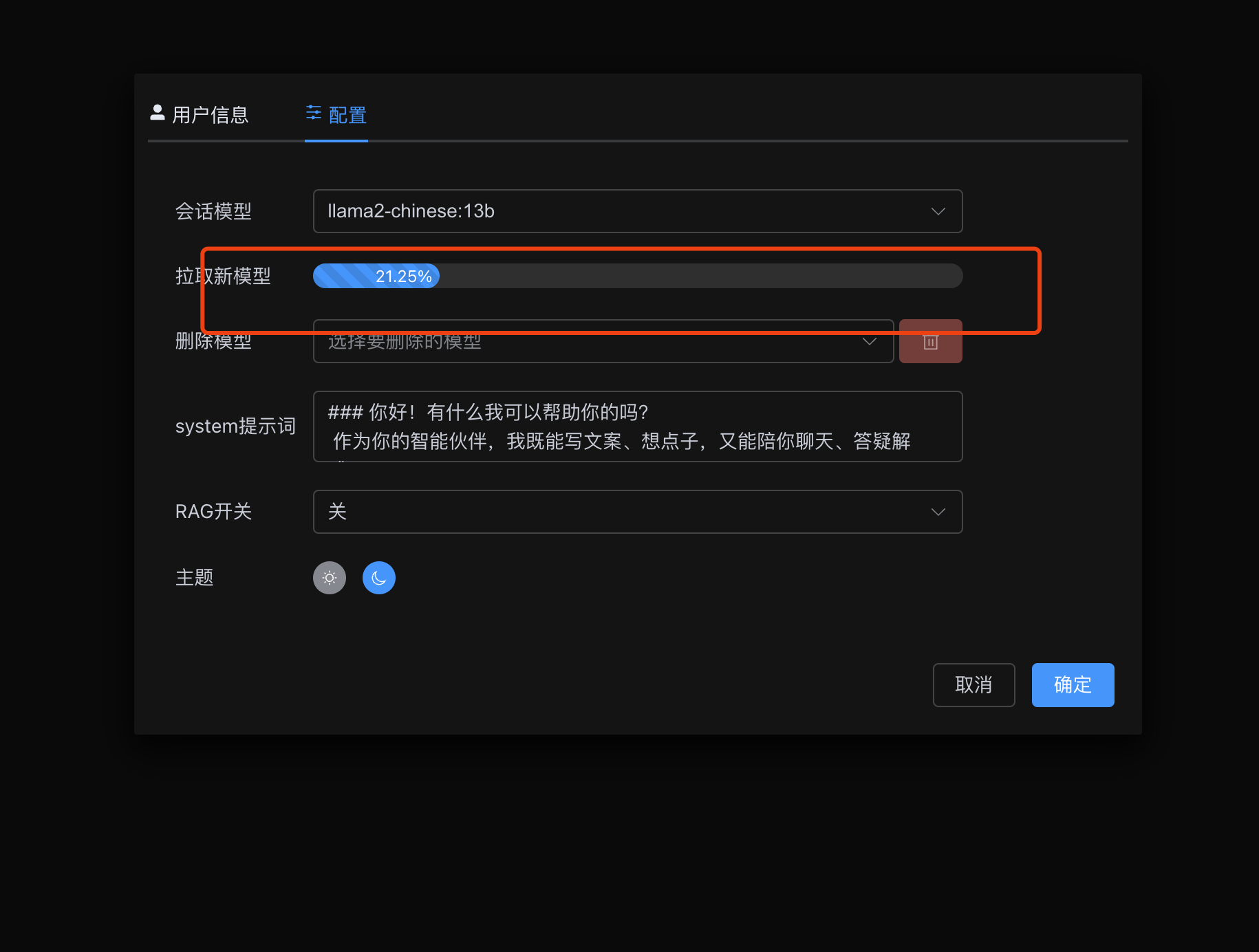

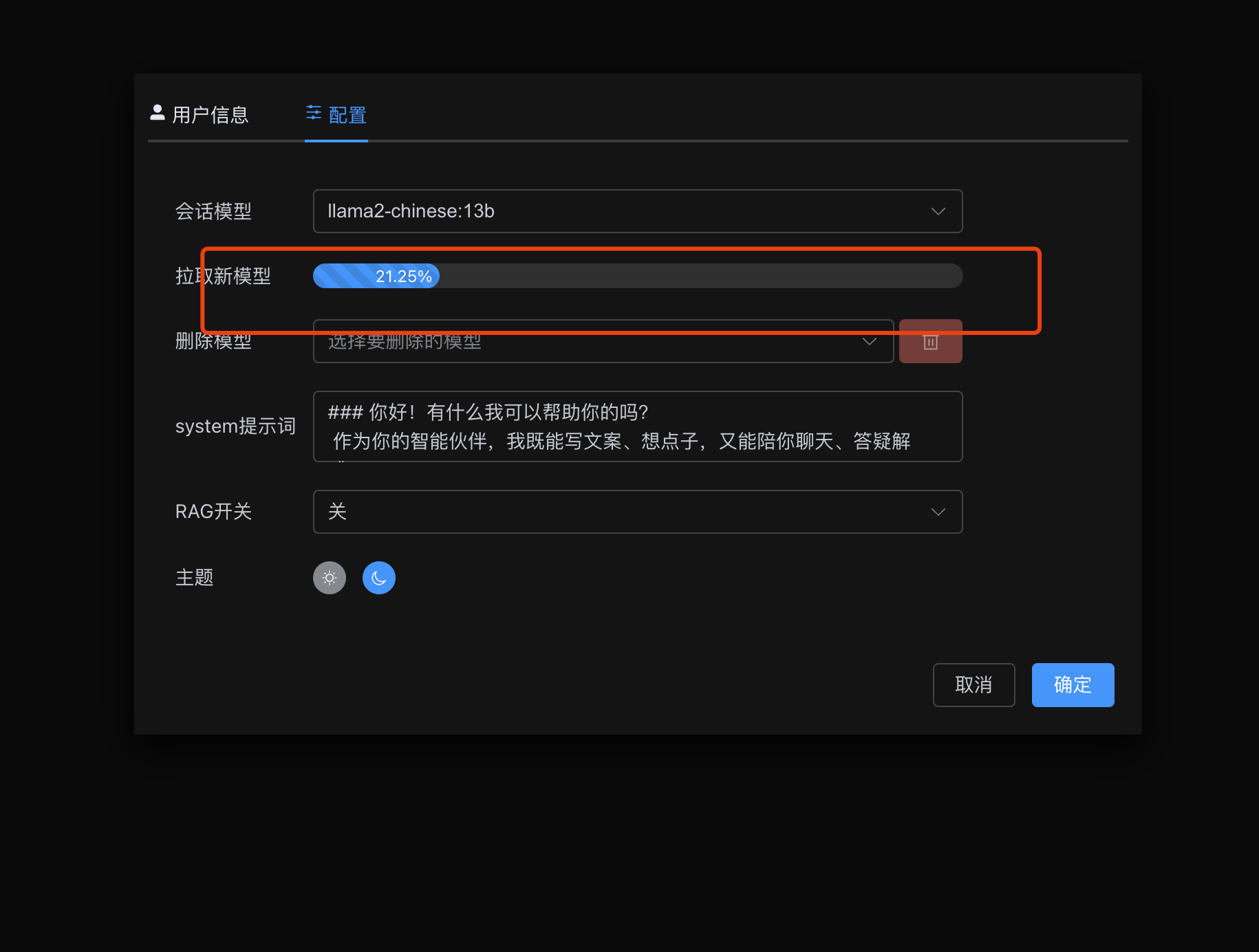

点击设置按钮,打开设置对话框,输入模型名称,例如:

qwen:0.5b,点击按钮开始拉取模型

-

选择刚刚拉取好的模型后,点击确定。就可以开始聊天了

使用rag

什么是rag,例如你问ai:你的名字叫什么?,他会告诉你他是个ai模型...,这不是我想要的答案,怎么办?有两种方式,1.训练自己的模型。2.在prompt里嵌入自己的文案。例如:你的名字叫小虎,请参考这个问题来回答: 你的名字叫什么,这时候他会回答,他的名字叫小虎。

- 如果你要使用rag,请先安装chroma数据库,点击查看文档

chroma run启动数据库服务- 你还需拉取ollama的嵌入式模型

mxbai-embed-large,点击查看文档 - 然后调用serve/app/router里的接口,添加数据

router.post('/adddata', controller.chat.adddatafordb); - 在webui的设置对话框里,开启rag开关,就可以聊天了

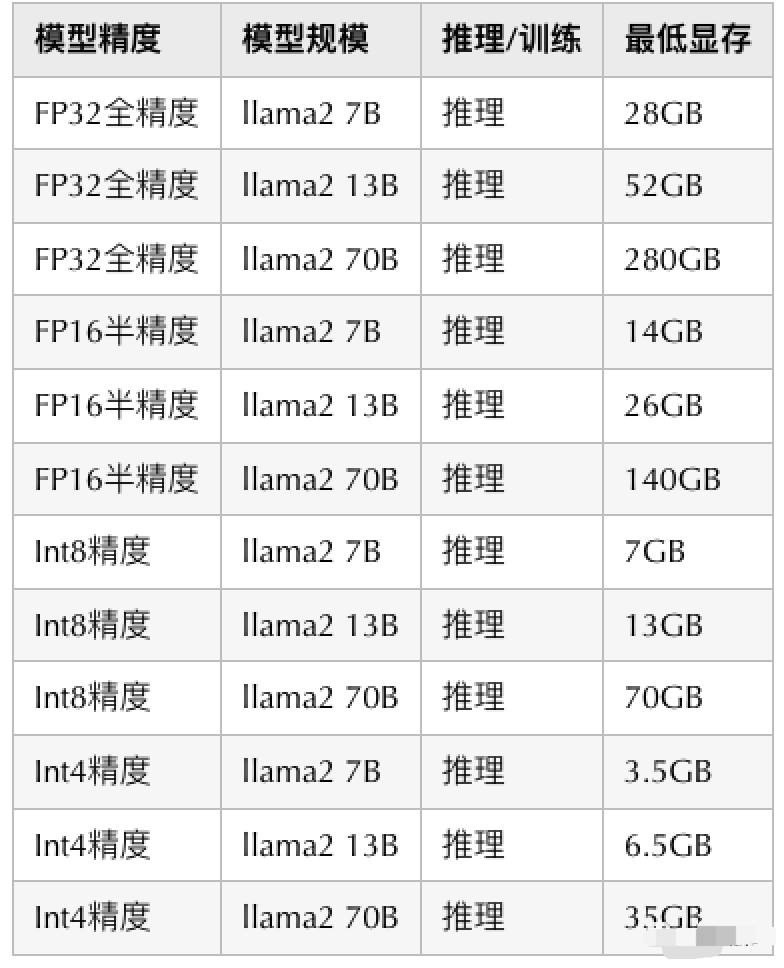

模型推理内存损耗

- 以llama2为例计算